Par Christophe Bénavent

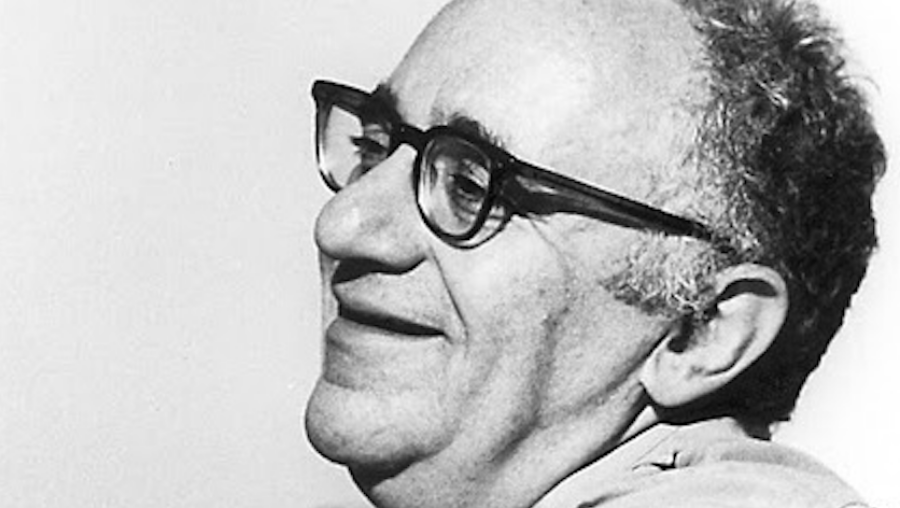

Une interview rapide accordée à Atlantico vendredi dernier me donne l’occasion de revenir sur la question des technologies persuasives, dont on doit à Fogg d’avoir énoncé le premier l’expression. Mais c’est une formule sans doute inexacte.

La persuasion est ce que les psycho-sociologues et les publicitaires étudient depuis bien longtemps, et pour lequel le modèle ELM de Petty et Cacioppo est central en faisant du changement d’attitude un processus à double route qu’aiguille une combinaison de motivations et de compétences. Ce sont d’ailleurs ces deux variables que l’on retrouve chez Fogg. L’inexact c’est que pour la publicité la persuasion passe par un changement d’opinion, et que dans le cas des technologies l’action s’opère directement au moment de la décision, dans ce fragment de seconde qui précède l’action, sans forcément demander de changements d’opinion.

Voilà une différence majeure entre la communication dans l’univers des mass media et celle qui se déroule dans le monde digital entre des consommateurs appareillés et des machines. C’est une question d’échelle : l’une s’adresse à la relation générale qui réside entre ce que nous pensons et ce que nous faisons (cf. la théorie de l’action raisonnée), c’est-à-dire à notre capacité délibérative, l’autre s’adresse aux micro-décisions, à nos réflexes, et très certainement à nos automatismes mentaux. Cette notion de technologie persuasive est convaincante, mais elle mériterait d’être plus proprement dénommée « technologie prescriptive ».

Examiner les dispositifs techniques et les construire en prenant en compte les biais cognitifs auxquels notre décision est soumise (et ces biais peuvent être nombreux comme l’indique cette liste de wikipedia) constituent la problématique clé de ce domaine de recherche et de conception. Il peut emprunter à la psychologie de la motivation, tout particulièrement à la question du contrôle (locus of control, perceived behavioral control, self-efficacy, level of construct…), à l’économie comportementale qui est en plein essor, tout autant qu’à la philosophie politique du nudge.

Du côté des dispositifs il y a sans doute une typologie à établir car ceux-ci couvrent une grande variété de formes. Ils jouent sur l’effet d’influence sociale en se matérialisant sous la forme de notes et d’avis. Ils peuvent prendre un caractère prédictif comme dans le cas des moteurs de recommandation qui anticipent les désirs ou du moins les excitent. Ils vont se diffuser à grande échelle sous la forme de boucles de feed-back avec les objets connectés et leurs applications.

Le problème politique et moral se pose simplement en rappelant la définition du nudge que Sunstein, Thaller et Baltz proposent : un élément de l’architecture du choix qui aide les gens à faire ce qu’ils veulent faire. L’architecte est celui qui conçoit l’environnement du choix : sa connaissance des comportements, des limites cognitives des individus et de leurs buts doit le guider dans la conception de ces dispositifs d’influence.

Prenons l’exemple élémentaire de la sécurité routière. Pour réduire la vitesse moyenne et les accidents, outre l’option autoritaire des radars, on imagine désormais des dispositifs qui calculent le style de conduite et en informent le conducteur ; certains assureurs sont prêts à récompenser ceux qui adoptent et maintiennent une conduite plus souple et prudente. Le rôle de l’architecte est de concevoir un tel dispositif, de telle manière à ce qu’il produise effectivement – même partiellement – les changements de styles de conduite souhaités.

Ces dispositifs peuvent varier selon différentes modalités : formulation des options par défaut (dans notre cas, un régulateur de vitesse), évitement des erreurs attendues, feed-back (un cadran de consommation d’essence instantané plus visible que le compteur de vitesse), mapping, structuration des décisions et des incitations (un bonus pour les assurés qui acceptent le système).

Il va de soi que si le souci de faire le bien de l’usager (en réduisant le risque d’accident, la pollution et l’économie d’essence) est légitime, ces mêmes dispositifs peuvent être aussi conçus pour inciter à d’autres actions plus favorables à l’intérêt de l’architecte : l’assureur pourrait être tenté d’infléchir sur le choix de la route dans le but de nous amener sur des parcours moins accidentogènes (l’autoroute) quitte à ce que cela nous coûte plus cher. On imagine que cela pourrait se faire de façon furtive, en biaisant les indications de direction fournies par le GPS. Nous perdrions alors la liberté d’aller au plus court (notre intérêt).

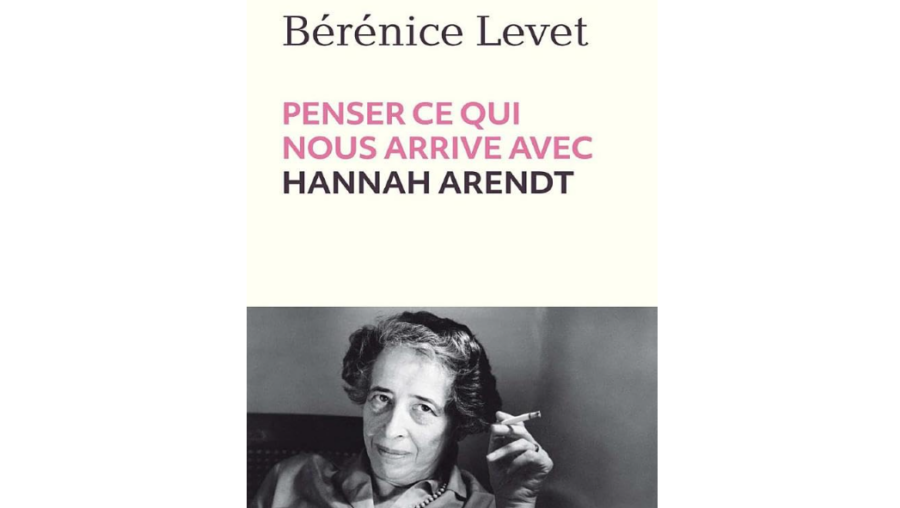

Bien sûr ces auteurs inscrivent le nudging dans la perspective d’un paternalisme bienveillant et libertarien dont nous pensons qu’elle mérite plus d’écho à la fois parce qu’elle permet, face à la crise démocratique, de réfléchir aux nouvelles justifications et aux nouveaux rôles de l’action publique, mais surtout parce qu’elle est essentielle pour penser les interférences du digital dans nos décisions qui, pour suivre Raphaël Suire par exemple, peuvent détruire l’espace de liberté qu’est ou que fut internet.

Pour s’en tenir aux technologies persuasives, l’architecture du choix n’exige pas simplement le consentement des personnes vulnérables dont on veut prendre soin (à supposer qu’elles ne sont pas toujours en condition de faire les meilleurs choix pour elles-mêmes), mais aussi un moyen de contrôle sur ces dispositifs, au minimum la connaissance de leur existence et de leurs mécanismes, la transparence algorithmique.

Mais ce n’est pas tout. Les technologies persuasives dans le monde digital ne sont pas uniquement développées pour aider des consommateurs limités cognitivement à faire de meilleurs choix, elles le sont aussi pour inciter à des comportements qui rendent plus attractives les collectivités qui habitent les plateformes. Quand facebook expérimente sur des centaines de milliers de sujets l’effet d’un algorithme de filtrage qui favorise un contenu positif, le problème n’est pas simplement celui d’une éthique de l’expérimentation qui interdit que les sujets de l’expérience n’en soient pas informés, mais celui de la finalité de la technique (le filtrage) qui ne correspond pas de manière évidente à l’intérêt propre des individus. La gouvernementalité de l’algorithmie à l’œuvre viole ici clairement la liberté en intervenant de manière arbitraire dans la décision.

On comprendra qu’en parallèle de l’effort de recherche visant à développer des nudges et autres technologies prescriptives, dont l’utilité ne doit pas être mise en cause dans la mesure où la science a désormais établi que nous ne sommes pas toujours en condition de prendre des décisions informées et optimales, une réflexion politique, morale et juridique doit en accompagner le développement.

—

Christophe Benavent free (Benavent C) / CC BY-NC-ND 3.0

Lire aussi :

Inquiétant tout ça.

Et instructif : je ne connaissais pas cette “liste des biais cognitifs”, dont j’aurais très largement sous-estimé le nombre. On est peu de chose et certains vont forcément approfondir et utiliser cette limite pour nous manipuler et nous asservir.

C’est fait depuis la nuit des temps, même que le contraire est l’exception.